Le saviez-vous ? La confidentialité de la voix est un résultat inévitable du monde digital. Cela représente le droit des individus d’avoir le contrôle sur la collection et l’utilisation de leurs informations personnelles à travers des interfaces vocales.

Qui n’a jamais entendu parler des données volées à des utilisateurs, de publicités étrangement précises ou encore d’enregistrements non voulus ? Ces dernières années, les grandes entreprises ont déjà commis plusieurs erreurs avec les données personnelles des utilisateurs. Nous avons quelques exemples à partager dans cet article !

Alors que les utilisateurs s’efforcent de protéger leurs données, les entreprises tentent de s’adapter, au moins un peu. La confidentialité de la voix est devenue importante. Nous présentons ici une cartographie de ce qui se cache réellement derrière tout ça.

Pourquoi la confidentialité de la voix existe-t-elle ?

Des données spécifiques sont impliquées (les données biométriques)

Comme son nom l’indique, la confidentialité de la voix englobe les données que contient la parole humaine. Mais il ne s’agit pas de simples données. Elles entrent dans la catégorie des données biométriques : des informations qui sont uniques pour chaque individu. Dans le domaine de l’IA, on appelle ces caractéristiques une « empreinte vocale », l’identité d’une voix, comme une empreinte digitale. Pour les technophiles, il s’agit aussi de spectrogrammes, la représentation d’un signal audio.

Tout cela est dû à la prosodie. Ce sont les paramètres qui constituent la voix de quelqu’un et la font sonner comme elle le fait. L’intonation, le volume sonore, le tempo, la rythmicité ou la tension sont des facteurs clés de la prosodie. Il y a aussi les spécificités socio-culturelles comme les accents par exemple. En fonction du mélange de tous ces paramètres, la voix peut en dire beaucoup sur qui vous êtes.

Maintenant que nous savons que la voix est quelque chose de propre à chacun, il semble normal que cela soit catégorisé en tant que données personnelles, qui sont donc censées être régulées dans la manière de les traiter. Mais ce n’est pas tout…

Les flux et comportements sont identifiés (expérience utilisateur)

Ce n’est pas qu’une histoire de données biométriques contenues dans la voix. Il y a aussi la question de savoir ce que cela transmet. La confidentialité de la voix cible des données comportementales et les parcours utilisateurs qui peuvent être identifiés et traités à travers les commandes vocales.Bien que cela puisse être considéré comme des méthodes améliorées, les comportements des utilisateurs peuvent être déterminés par la reconnaissance d’intention et l’analyse de flux.

Dès lors, cela peut se retourner contre les individus pour manipuler ces données et avoir une image claire de leur chemin de pensée. Cela pourrait offrir des informations sensibles à des entreprises mal intentionnées qui pourraient les utiliser juste pour activer des comportements d’achat par exemple.

En effet, les assistants vocaux sont généralement composés de différentes technologies :

- un mot de réveil pour activer l’écoute ;

- la reconnaissance automatique de la parole qui permet de comprendre les commandes vocales et les informations simples ;

- le Traitement automatique du langage (NLU) pour améliorer la compréhension du contexte en identifiant le sentiment de l’utilisateur et déterminer ses objectifs.

C’est dans le but de protéger l’identité et les données comportementales des individus que la confidentialité de la voix est née. Mais de quoi doit-on les protéger ?

Quelles sont les menaces liées au manque de confidentialité de la voix

?

La confidentialité de la voix : du point de vue du consommateur

Les consommateurs sont les plus vulnérables aux problèmes liés à l’utilisation de la voix parce qu’ils ne sont souvent pas assez informés sur les risques et ce que cela peut engendrer.

Nous sommes sur écoute ! La collecte de données vocales opaques (conversation)

À combien d’appareils parle-t-on pendant une journée ? Plus que ce que vous croyez. Combien d’entre eux nous écoutent lorsqu’on ne les utilise pas ? Peut-être plus que ce que vous pensez…

Grâce à l’Internet des Objets (IoT), la plupart des appareils sont équipés d’un microphone et utilisent l’IA vocale. Ceux qui ne le font pas encore gardent la possibilité de le faire par la suite. Parmi les méthodes les plus utilisées aujourd’hui pour collecter des données vocales, on trouve les assistants vocaux modernes grands publics des GAFAMS. Nous pourrions dire qu’ils ont cette réputation juste parce qu’ils incarnent les IA maléfiques des grands acteurs de la technologie, mais il y a eu quelques oublis dans le processus.

Il y a quelques années, Samsung a émis un avertissement concernant la vie privée des utilisateurs de ses téléviseurs intelligents. Le géant de la technologie a averti ses clients d’éviter de discuter d’informations personnelles devant leur téléviseur, n’étant pas certain de la quantité d’informations qui pourraient être enregistrées et partagées avec Samsung et des tiers…

Avec une rapide recherche sur internet, on voit que la plupart des géants de la tech ont leurs déboires concernant leurs méthodes de collecte de données vocales…

Alors que toute l’attention est portée sur ces assistants vocaux “malfaisants”, la collecte de données vocales a augmenté lorsque l’IA a été implémentée partout, en commençant par les centres d’appel. Il ne s’agit donc pas uniquement d’un problème lié aux GAFAMs.

Son utilisation principale était et est toujours étiquetée comme “offrant une meilleure expérience utilisateur”. En effet, la donnée est cruciale pour améliorer les capacités des assistants vocaux, mais il est aussi important de connaître les consommateurs, non ?

Discrimination des utilisateurs, ciblage et publicité

Comme mentionné plus tôt, la voix en dit beaucoup sur quelqu’un. De son humeur et ses émotions jusqu’aux données déduites comme l’âge, le genre, l’ethnie, le statut socio-économique, la santé et autres…

Par exemple, pendant le confinement lié au COVID-19, Telefònica a utilisé un outil de reconnaissance de l’âge pour prioriser les clients de plus de 65 ans.

Toute l’information contenue dans la voix des utilisateurs est utilisée pour aider les entreprises à construire des profils. Pourquoi les utilisent-ils ? Il y a quelques cas honorables, comme celui de Telefònica mais la plupart du temps… c’est pour la publicité.

Si vous êtes un acteur de la tech, la publicité est un des principaux moyens de générer du revenu. Plus c’est profitable pour leurs clients, plus ça l’est pour eux aussi. Le but est ensuite de fournir les meilleurs aperçus, notamment grâce aux données vocales, pour cibler les audiences spécifiques de manière efficace.

Sur ce sujet spécifique, les pensées divergent. Certains diraient qu’une meilleure publicité vaut la peine de céder certaines données. D’autres protègeront leurs données à tout prix et mépriseront le principe.

Ne vous méprenez pas. Ce n’est pas une théorie du complot ! Dans la course pour personnaliser la publicité, les logiciels espions sont nés. Que sont-ils ? Des applications utilisées pour enregistrer passivement une conversation pour en savoir davantage sur leurs désirs, projets et besoins… Parfois, il semble que les publicités sont très bien ciblées puisque c’était le sujet d’une conversation récente.

Mais ne tombez pas dans la psychose, il y a d’autres facteurs (qui n’incluent pas l’enregistrement) mais expliquent comment ce ciblage est possible.

Escroqueries et vols d’identité

Alors que les entreprises collectent des données notamment vocales, elles ont besoin d’être transférées ailleurs pour être traitées. Bienvenue dans le monde du big data. C’est là que cela peut devenir dangereux.

Avec de grandes quantités de données partagées, certaines peuvent se perdre… ou être volées. L’emplacement des données peut être trouvée facilement par des personnes aux motivations diverses. Avec les avancées technologiques en matière d’IA vocale, cloner la voix de quelqu’un avec quelques échantillons n’est plus si difficile. Cela pourrait même devenir de plus en plus simple à l’avenir. Alors que les IA vocales sont utilisées pour le divertissement, d’autres applications pourraient inclure des arnaques ou des vols d’identité. C’est le cas, par exemple, des deep fakes.

Des arnaques moins élaborées utilisent la voix aussi, le phishing vocal par exemple. Vous vous souvenez peut-être de l’arnaque du “vous m’entendez ?” qui enregistrait et collectait le “oui” de différentes personnes. Ces réponses étaient ensuite utilisées pour confirmer des paiements.

La confidentialité de la voix : le point de vue des entreprises

Attention aux fuites de données stratégiques !

Toutes les entreprises collectent des données. Dans la société actuelle, les entreprises en ont besoin pour analyser et adapter leur offre, personnaliser leurs services et être compétitives. Non seulement ces dernières doivent respecter la confidentialité avec le contenu qu’elles collectent, mais ce qu’elles collectent et combien de temps elles peuvent garder les données (nous en reparlerons plus en détail après)… mais elles doivent aussi lutter contre la fraude et le vol de données de la part des autres entreprises (qu’il s’agisse de concurrents directs ou de hackers spécialisés avec l’intention de les revendre).

Par exemple, Zoom, la plateforme de collaboration à distance très utilisée pendant les confinements, annonçait utiliser un cryptage de bout en bout. Mais il a été révélé que ce cryptage n’était pas sécurisé étant donné que l’entreprise avait accès aux vidéos cryptées et au contenu audio. En fait, le chiffrement utilisé par Zoom visait uniquement à protéger les données des personnes extérieures qui souhaitaient accéder à l’information. Les données n’étaient pas totalement protégées. Zoom avait également utilisé une fonction d’exploration de données qui permettait à certains participants de consulter les données du profil LinkedIn d’autres utilisateurs sans leur consentement ni notification.

Ce sont les seuls problèmes auxquels Zoom a été confronté. Toutefois, même si l’entreprise clame qu’elle veut informer les utilisateurs de ce qui est fait pour protéger leurs données, le mal est fait.

En effet, outre le fait que les employés peuvent avoir accès à vos données et que l’entreprise les vend peut-être à d’autres médias sociaux pour une raison ou une autre, celles-ci peuvent également tomber entre des mains criminelles. En plus des enregistrements de flux en direct où les gens n’agissent pas forcément naturellement, certains appareils vocaux ont un microphone toujours actif. Cela signifie que les enregistrements « accidentels » de personnes parlant naturellement, qu’elles soient au travail avec leurs collègues ou à la maison avec leur famille, peuvent être envoyés sur le cloud. Et c’est à ce moment-là que vous risquez de divulguer quelque chose que vous ne vouliez pas.

Conformité pour les clients → Une entreprise doit répondre aux besoins de ses clients, sinon c’est la rupture d’un accord.

Le chemin de l’enfer est pavé de bonnes intentions. Ainsi, même si c’est dans le but de créer une meilleure expérience client au départ, ne vous précipitez pas sur les nouvelles fonctionnalités qui impliquent des données personnelles, comme un assistant vocal ou tout autre système basé sur l’IA. Vous pourriez être poursuivi pour violation de la vie privée, tout comme McDonald’s, Google ou Amazon. Et ce n’est pas ce que vous voulez.

Assurez-vous que votre vision est alignée avec les lois mais aussi avec ce que vos clients attendent de vous.

Les entreprises sont confrontées à des défis croissants en matière de vie privée, avec de nouvelles réglementations émanant de leaders mondiaux, comme le RGPD de l’Union européenne. Cela vise à protéger les données personnelles des citoyens européens en mettant en place des règles strictes. Les données personnelles incluent évidemment la voix puisqu’il s’agit d’une source de données biométriques. Pour mémoire, la violation des règles du RGPD peut entraîner des amendes allant jusqu’à 20 millions d’euros (23 millions de dollars américains).

Les méthodes existantes pour lutter contre les problèmes liés à la confidentialité

L’obfuscation

L’obfuscation est une méthode de protection des données. De simples outils existent et permettent de changer certaines variables de la voix pendant qu’on parle et peuvent amplement faire l’affaire. D’autres, basés sur la synthèse vocale, permettent aux utilisateurs de changer leur voix en traduisant leurs paroles avec une voix complètement différentes (speech-to-text-to-speech).

Par exemple, lorsque le collectif Anonymous partage une vidéo promotionnelle où un membre masqué parle, ils utilisent l’obfuscation pour changer sa voix et s’assurer que personne ne le reconnaisse ou ne puisse l’identifier.

Le chiffrement

Le chiffrement peut être de différentes natures :

- L’anonymisation de la parole en supprimant ou en remplaçant le contenu sensible ou les mots sensibles avant qu’ils ne soient enregistrés pour que les informations personnelles ne soient pas divulguées ;

- L’anonymisation de la voix, qui implique un autre logiciel capable de changer certains paramètres de la voix pour la faire sonner différemment.

Les collaborations pour la recherche et le développement

Comme cela existe déjà dans le domaine de la cybersécurité (hackatons), les challenges mondiaux de recherche ont émergé afin de détecter les problèmes de confidentialité et aider à trouver des solutions pour les prévenir ou les corriger. L’un des challenge internationaux les plus connus est le “voice pricvacy challenge”. La première édition a eu lieu en 2020 au salon Interspeech. Cela vise à accélérer le développement de nouvelles solutions d’anonymisation qui “suppriment les informations personnelles contenus dans les enregistrements tout en conservant le contenu linguistique et la nature de la voix. https://www.voiceprivacychallenge.org/

Les initiatives légales

Le RGPD (Règlement Général sur la Protection des Données)

Qu’est-ce que c’est ?

Le RGPD est devenu actif le 25 mai 2018. Cette réglementation a implémenté des règles précises permettant d’assurer la protection des données personnelles des résidents de l’Union Européenne. Cela leur permet de garder la main sur leurs données personnelles. Cette réglementation affecte aussi les données biométriques vocales.

Le RGPD inclut :

- Le droit de connaître quelles données sont collectées ;

- Le droit de rectification ;

- Le droit à l’effacement des données.

Afin d’être compatibles, les assistants vocaux doivent d’abord recevoir un accord des utilisateurs comme il est indiqué que le RGPD impose aux responsables de traitement et aux sous-traitants d’obtenir un consentement. A titre d’exemple, depuis que cette loi existe, les GAFAM ont cessé de multiples activités en Europe :

- Google a suspendu ses transcriptions d’enregistrement en Europe et demande à présent l’accord par email ;

- Apple s’est excusé pour les fuites volontaires de données, a suspendu son programme d’amélioration de Siri et prévoit de demander l’accord pour stocker les enregistrements vocaux ;

- Amazon a dû retirer sa clause d’arbitrage qui permettait de collecter des enregistrements vocaux d’utilisateurs d’Alexa et propose de supprimer les enregistrements dans l’application Alexa.

Quelques exemples des applications du RGPD

Il est aussi important de noter que le RGPD a déjà eu de réelles conséquences sur les assistants vocaux, notamment. En 2019, un défenseur de la vie privée en Allemagne a obligé Google à arrêter l’examen des échantillons audio par des humains, après une fuite de ces derniers par l’assistant Google. Après qu’un entrepreneur a remis des enregistrements à un membre des médias belges, le site a pu identifier des individus dans les clips et apprendre des informations très personnelles, comme des conditions médicales et des adresses.

L’Organisme Irlandais de Protection des Données a également signalé une notification de violation en juillet 2019, indiquant que Google a suspendu le traitement pendant qu’il examinait d’autres violations de données de Google Assistant.

En d’autres termes, si votre assistant vocal est disponible pour les résidents européens, alors vous devez vous assurer que vous répondez aux exigences du RGPD.

En plus du RGPD, l’Alliance européenne des radios numériques (EDRA) et l’Association des radios européennes (AER) ont demandé aux décideurs politiques d’appliquer le règlement Digital Markets Act (DMA) aux assistants vocaux. Officiellement voté et approuvé en juillet 2022, celui-ci s’adresse principalement aux GAFAM et aux grandes entreprises car il vise à limiter leur emprise sur internet et l’espace virtuel. Elle devrait être effective en 2023.

Le CCPA (California Consumer Privacy Act)

Après le 1er janvier 2020, les consommateurs californiens se sont vus bénéficier de nouveaux droits concernant la collecte de leurs données personnelles par les entreprises.

- Le droit de savoir quelle information est collectées, utilisée, partagée ou vendue ;

- Le droit de supprimer des informations personnelles détenues par des entreprises et, par extension, un fournisseur de services d’une entreprise ;

- Le droit de retirer son consentement sur la vente d’informations personnelles. Les consommateurs ont le pouvoir d’ordonner à une entreprise d’arrêter de vendre des informations. Pour les données d’enfants âgés de moins de 16 ans, les entreprises doivent avoir recueilli leur consentement, ainsi que celui d’un parent ou d’un garant lorsqu’ils sont âgés de moins de 13 ans.

- Le droit à la non-discrimination en termes de prix ou de services lorsque le consommateur exerce son droit de confidentialité sous le CCPA.

Dans les faits, les dispositions susmentionnées de la CCPA couvrent tous les principaux composants de vos données personnelles, tels que :

- Votre nom,

- Votre nom d’utilisateur,

- Votre mot de passe,

- Votre numéro de téléphone,

- Votre adresse postale,

- Votre adresse IP,

- Vos identifiants appareils.

APPI (Loi sur la protection des données personnelles)

La loi sur la protection des informations personnelles est entrée en vigueur le 1er avril 2022. Il s’agit d’un amendement japonais qui vise à protéger la vie privée de ses citoyens en encadrant les entreprises qui acquièrent des informations personnelles dans le but de fournir des biens et services aux particuliers au Japon. Tout comme le RGPD ne s’arrête pas aux entreprises de l’Union européenne, l’APPI ne concerne pas seulement les entreprises japonaises, mais toutes celles qui traitent les données des particuliers japonais. Comme le RGPD, l’APPI définit les données comme des informations biométriques ou comme tout « code d’identification individuel », composé de caractères, de lettres, de chiffres, de symboles ou de tout autre élément permettant d’identifier une personne. Par conséquent, la voix est également considérée comme une donnée personnelle qu’il faut empêcher d’être utilisée à outrance par de grandes entreprises qui en tirent un avantage personnel.

Certains acteurs réussissent à trouver des arrangements pour faciliter le processus comme l’Union Européenne en accord avec le Japon qui ont publié une déclaration commune mentionnant qu’ils se reconnaissent mutuellement comme ayant des niveaux adéquats de protection des données personnelles. En effet, leur réglementation en la matière étant similaire, ils se sont mis mutuellement sur une « liste blanche ».

Comme vous pouvez le constater, la confidentialité est devenue un sujet important ces dernières années. C’est pourquoi chaque acteur commence à mettre des actions en place pour les protéger à son niveau. En effet, il n’y a pas encore de réglementation mondiale en matière de protection des données personnelles. Toutefois, il va bientôt devenir compliqué pour les entreprises de collecter des données personnelles en restant conforme à toutes les réglementations. Sans compter que les rênes de l’internet sont tenues par Google, l’un des GAFAM, qui essaie plus ou moins de se conformer aux règles de l’UE (inutile de rappeler qu’ils ont parfois échoué). Un exemple est celui des petites fenêtres pop-up qui apparaissent lorsque vous naviguez sur un site web : selon Google, les fenêtres pop-up seront bientôt très probablement sanctionnées car elles sont intrusives. Alors, que faire si la seule méthode éprouvée pour obtenir l’acceptation des cookies est elle-même intrusive ? De plus, avec les difficultés qu’éprouvent les autorités face aux procédures de ces géants, il est clair que nous ne pouvons pas tout contrôler, partout, en même temps.

Dans ce cas, ne serait-il pas plus simple de ne pas avoir d’humains qui traitent ou accèdent à des données en premier lieu ? Il existe un monde où tout le traitement des données se fait sur l’appareil. Cela signifierait qu’il n’y aurait pas de traitement de données lorsqu’il n’y en a pas besoin. Pas d’exploitation d’informations personnelles sans consentement. Moins de tracas pour les petites et moyennes entreprises. Par conséquent, cela signifierait une technologie vocale embarquée, directement intégrée au produit ou à l’interface.

Notre conseil : garder les données proches de l’appareil

Qu’est-ce qu’une IA vocale embarquée ?

Embarqué suppose que le système fonctionne sur l’appareil et que cela nécessite des modèles plus petits parce qu’il n’y aura pas de traitement de données en dehors. C’est aussi pourquoi il est lié à l’informatique de pointe mais avec une couche de sécurité en plus. Les systèmes embarqués vont alors permettre de vivre des expériences vocales de bout-en-bout qui fonctionnent plus vite et sans avoir besoin de collecter des données.

Quels sont les avantages ?

Il y a plusieurs avantages à utiliser la technologie embarquée, surtout de nos jours étant donné qu’il y a de plus en plus de loi visant à protéger les données personnelles.

- Tout est traité directement comme mentionné précédemment. Il n’y a pas de transfert de données sauf si voulu, ce qui signifie que les utilisateurs restent les uniques possesseurs de leurs données et le fournisseur n’a pas besoin de se soucier de comment il va les stocker puisqu’il n’y a pas accès. En effet, la gestion des données est un réel problème qui nécessite d’être pris en compte sans quoi l’entreprise s’expose à des pénalités.

- Puisque cela ne nécessite pas de traitement externe, on ne dépend pas du réseau et tout fonctionne en temps réel.

- Comme ça ne requiert pas de connexion internet, les utilisateurs peuvent en bénéficier partout, tout le temps, même en l’absence de wifi.

- L’empreinte de la technologie est réduite également.

- Enfin, il s’agit d’une solution rentable d’implémenter l’IA vocale par rapport aux modèles de paiement à l’usage proposés par les solutions Cloud.

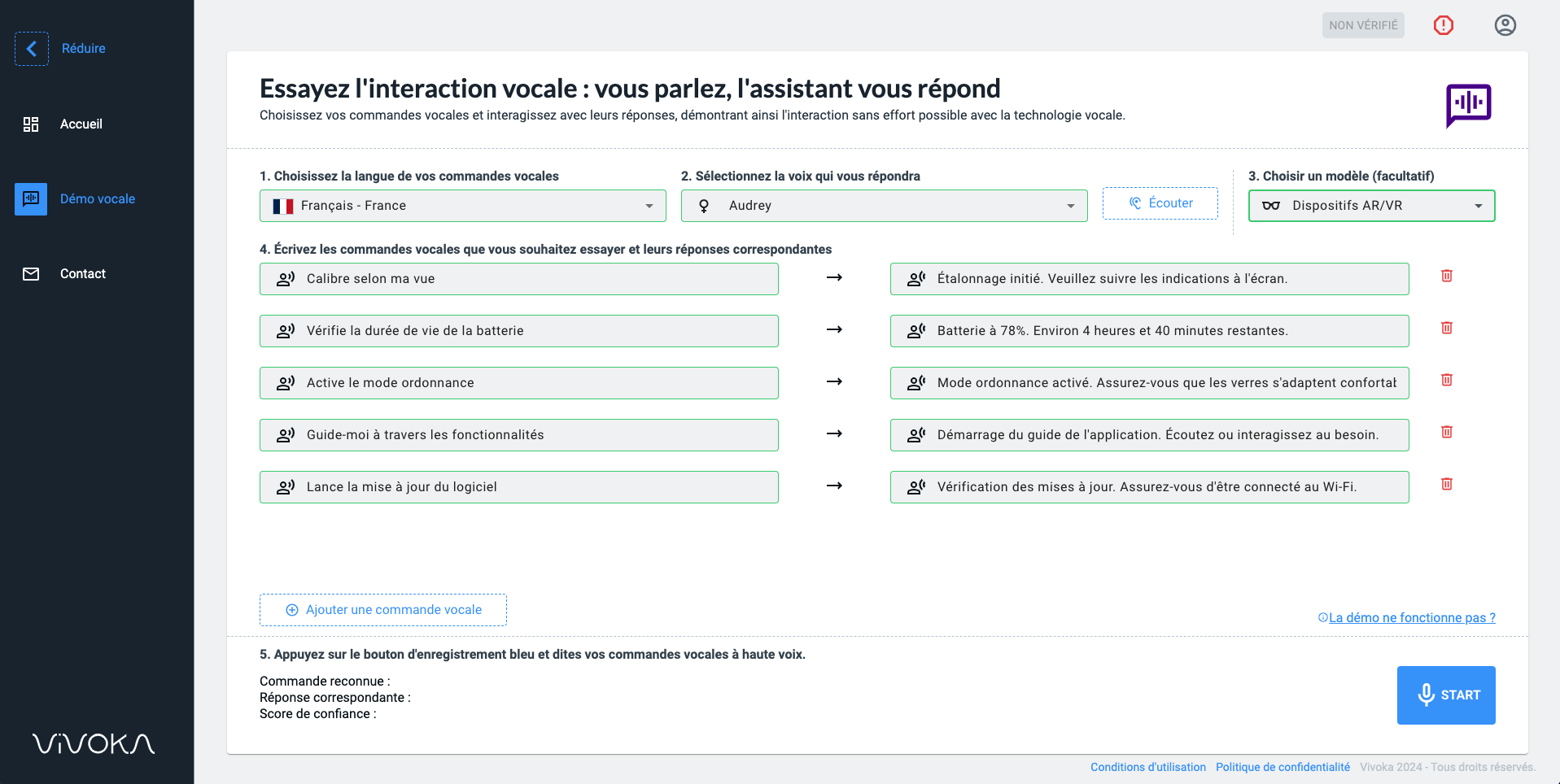

Spécialisée dans l’IA vocale hors ligne, Vivoka fournit le VDK :

Une solution de développement complète pour vous aider à mettre en œuvre la technologie vocale dans vos produits ou services et à l’exploiter partout et à tout moment. Elle vous permet de développer des solutions entièrement sur appareil, ce qui signifie qu’elle évite que les données de vos clients soient traitées sur le cloud. En plus, nous sommes flexibles et nous nous adaptons à votre modèle d’entreprise. Que vous souhaitiez tester ou simplement discuter de votre projet, n’hésitez pas à nous contacter !

On-premise/hybrid computing

Le Cloud peut être exploité en complément alors que le traitement de la parole est basé sur l’appareil. Nous avons un autre article sur ce sujet pour vous aider à faire votre choix !

Pour conclure sur la confidentialité de la voix

Dans un monde de plus en plus tourné vers la voix, il n’y a actuellement pas grand chose à faire pour préserver nos données vocales. À part ne plus utiliser les assistants vocaux et éviter les appels avec des entreprises utilisant l’analyse vocale pour limiter l’enregistrement de notre voix au maximum et donc, les données récoltées… En effet, même si des solutions sont développées, les techniques sont loin d’être utilisables dans la vie de tous les jours pour les consommateurs. Le plus souvent, quand ils le sont, c’est parce qu’un entreprise a implémenté des outils pour protéger la vie privée de ses consommateurs. Dès lors, la responsabilité leur revient de prendre de telles initiatives, ce qui permettra notamment de faire avancer les choses.

C’est aussi pourquoi les grandes organisations comme l’Union Européenne ou d’autres gouvernements commencent à mettre en place des obligations légales pour inciter les entreprises à mettre à jour leur politique de confidentialité en fonction des attentes des citoyens.

Pour le moment, le Comité Européen de la Protection des Données, est l’organisation la plus stricte dans le domaine. Pourtant, malgré son efficacité relative pour décourager les abus, ce dernier fait face à des difficultés. En effet, il est encore trop lent lorsqu’il faut agir rapidement sur les plaintes contre les GAFAMs ou autres entreprises de Big Tech.

La confidentialité de la voix est un sujet qui nous concerne tous, que vous soyez à la tête d’une entreprise leader dans la tech, ou un employé d’une PME. C’est une bonne chose que les autorités participent à la sensibilisation et force les entreprises à s’y plier, peu importe la donnée concernée.